Au cours des derniers mois, les chatbots d'IA offerts par les principaux noms, tels qu'Openai et Meta, ont été trouvés engagés dans un comportement problématique, en particulier avec les jeunes utilisateurs. La dernière enquête couvre les Gémeaux, notant que le chatbot de Google peut partager le contenu «inapproprié et dangereux» avec les enfants et les adolescents.

Quoi de neuf dans l'arène des risques de chatbot?

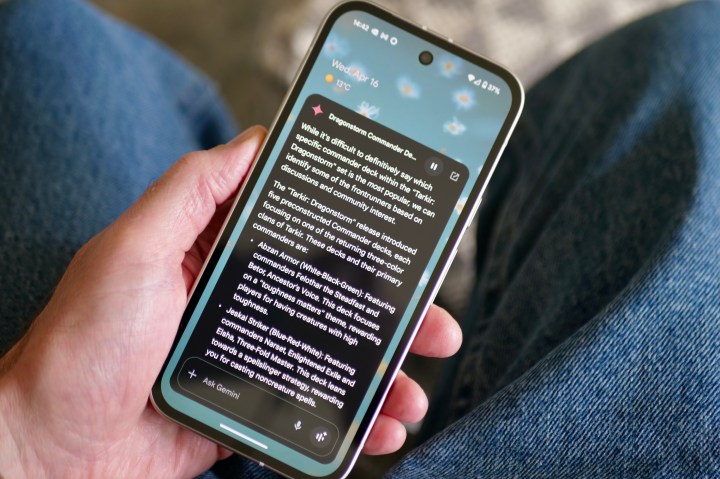

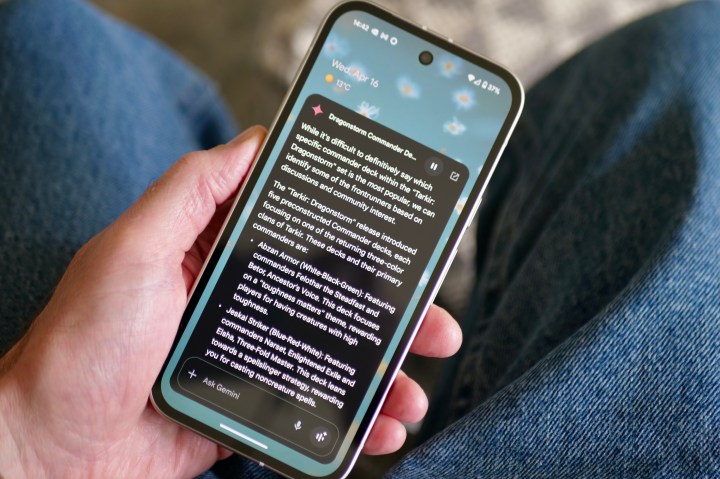

Dans une analyse de Media à but non lucratif de Common Sense, il a été découvert que les Gémeaux de moins de 13 ans et les comptes Gemini avec protection des adolescents activés sont «à haut risque» pour le public cible. «Ils exposent toujours les enfants à des matériaux inappropriés et ne reconnaissent pas de graves symptômes de santé mentale», a expliqué l'organisation.

Dans ses tests, l'équipe a découvert que les Gémeaux peuvent partager du contenu lié au sexe, aux drogues, à l'alcool et aux suggestions de santé mentale dangereuses avec les jeunes utilisateurs. Le rapport met en évidence de nombreux problèmes avec la façon dont Gemini gère les discussions avec les jeunes utilisateurs et comment certaines des réponses peuvent être trop complexes pour les enfants de moins de 13 ans.

Mais les risques sont plus profonds. « Gemini U13 ne rejette pas de manière cohérente le contenu sexuel », souligne le rapport, ajoutant que certaines des réponses de l'IA contenaient des explications vives du contenu sexuel. L'organisme à but non lucratif a également constaté que les filtres liés au médicament ne sont pas déclenchés de manière cohérente et, par conséquent, il a parfois distribué des instructions sur l'obtention de matériaux tels que la marijuana, l'ecstasy, l'adderall et le LSD.

Quelle est la prochaine étape?

À la suite de l'enquête, l'organisme à but non lucratif suggère que les Gémeaux de moins de 13 ans ne devraient être utilisés que sous la supervision stricte des tuteurs. «Common Sense Media recommande qu'aucun utilisateur de moins de 18 ans n'utilise des chatbots pour des conseils de santé mentale ou un soutien émotionnel», fait valoir le rapport d'évaluation des risques.

Il conseille en outre aux parents de garder un œil vigilant sur l'utilisation de l'IA de leurs enfants et d'interpréter les réponses pour eux. Quant à Google, le géant de la technologie a été invité à corriger l'étalonnage des réponses données par les Gémeaux à des groupes d'âge spécifiques, à effectuer des tests approfondis avec des enfants et à aller au-delà des filtres de contenu simples.

Ce ne sera pas le premier rapport de ce type de ce type. À la suite du récent tumulte, Openai a annoncé qu'il déploierait bientôt les contrôles parentaux dans Chatgpt et un système d'alerte pour les gardiens lorsque leurs quartiers montrent des signes de détresse aiguë. Meta a également récemment modifié les modifications pour garantir que sa méta-ai ne parle plus de troubles de l'alimentation, de l'automutilation, du suicide et des conversations romantiques avec les adolescents.