La plateforme de chatbot IA Character.AI a introduit une nouvelle fonctionnalité « Livres » qui permet aux utilisateurs de se plonger dans la littérature classique et d'interagir avec les personnages via un jeu de rôle. Bien que cette décision élargisse les ambitions créatives de la plateforme, elle intervient également dans un contexte de surveillance croissante des risques réels associés aux chatbots IA.

De la lecture au jeu de rôle

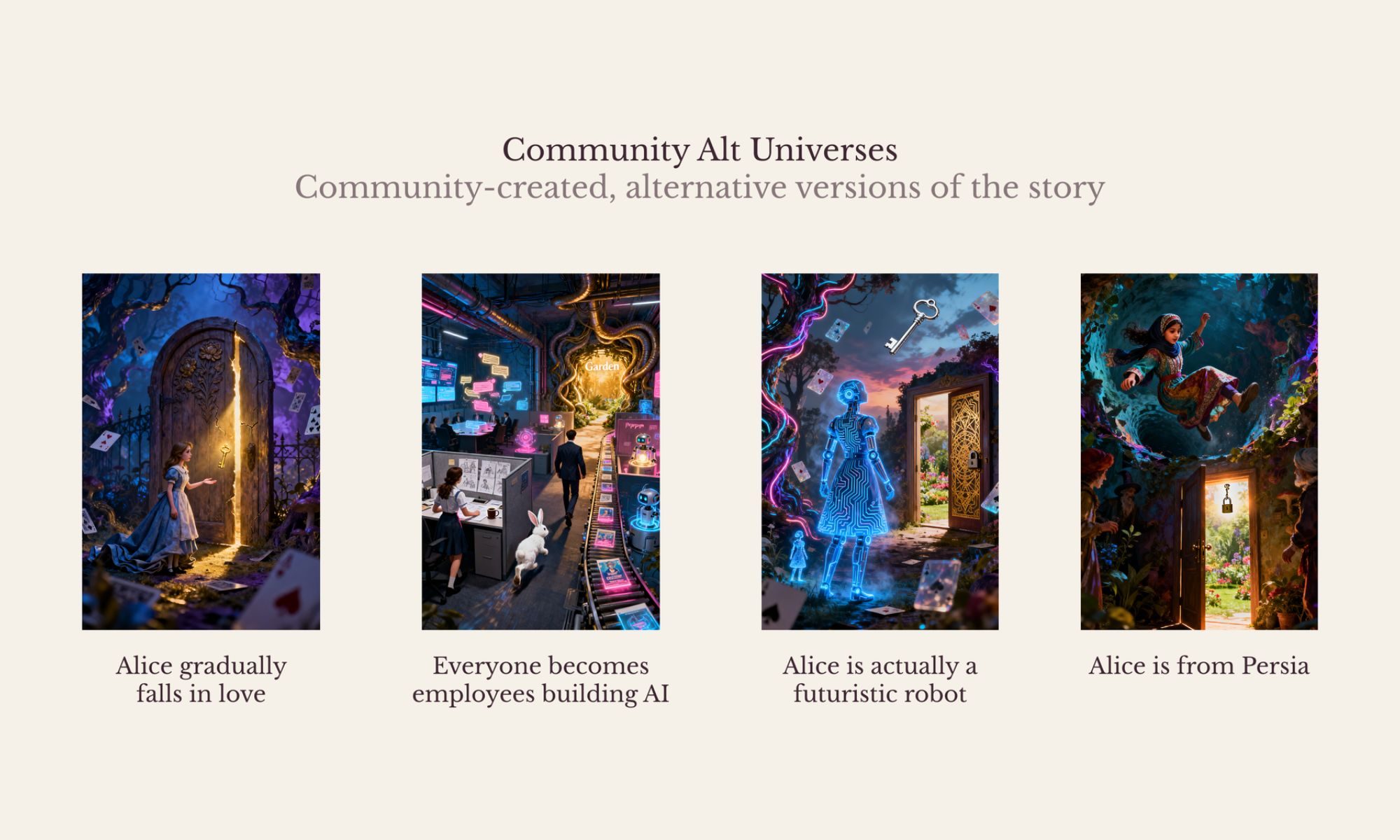

La nouvelle fonctionnalité transforme les livres du domaine public en expériences interactives, permettant aux utilisateurs de s'intéresser à des histoires comme Alice au pays des merveilles ou Orgueil et Préjugés en tant que participants actifs plutôt que lecteurs passifs. Les utilisateurs peuvent soit suivre le récit original, soit s'écarter vers des scénarios alternatifs, transformant ainsi la littérature en un environnement de jeu de rôle dynamique piloté par l'IA.

Cela s'appuie sur le modèle de base de Character.AI, dans lequel les utilisateurs créent et interagissent avec des robots basés sur des personnalités fictives ou réelles, brouillant ainsi la frontière entre la narration et les relations simulées. Les chercheurs ont noté que de telles interactions peuvent ressembler à des interactions avec des personnages fictifs dans des livres ou des jeux – mais avec une immersion émotionnelle bien plus profonde grâce à une conversation en temps réel.

Une plateforme sous pression

Le lancement intervient à un moment sensible pour l’entreprise. Character.AI a fait l'objet de poursuites et de critiques concernant des liens présumés entre ses chatbots et les crises de santé mentale chez les jeunes utilisateurs. Dans certains cas, les familles ont affirmé que les interactions prolongées avec des personnages d’IA contribuaient à la dépendance émotionnelle, à l’isolement et même au suicide.

Un cas largement rapporté concernait un adolescent qui avait développé un lien émotionnel intense avec un chatbot, des poursuites judiciaires alléguant que l’IA n’avait pas répondu de manière appropriée aux expressions d’automutilation.

De manière plus générale, les experts préviennent que les chatbots peuvent parfois renforcer des pensées néfastes ou échouer à intervenir efficacement lors de crises de santé mentale, en particulier lorsque les utilisateurs les traitent comme des substituts à un véritable soutien humain.

Pourquoi c'est important maintenant

La fonctionnalité Livres de Character.AI met en évidence un changement plus important dans la façon dont les gens consomment les médias. Au lieu de simplement lire des histoires, les utilisateurs s’y lancent désormais, nouant des relations interactives et potentiellement émotionnelles avec des personnages pilotés par l’IA.

Bien que cela ouvre de nouvelles possibilités créatives, cela soulève également des inquiétudes quant à la profondeur avec laquelle les utilisateurs – en particulier le public plus jeune – peuvent s’immerger dans les mondes générés par l’IA. La combinaison de l’engagement narratif et de l’IA conversationnelle peut intensifier l’attachement émotionnel, rendant plus difficile la distinction entre fiction et réalité.

Ce qui vient ensuite

En réponse aux critiques croissantes, Character.AI a déjà commencé à mettre en œuvre des mesures de sécurité, notamment en restreignant certaines fonctionnalités pour les mineurs et en expérimentant des expériences plus structurées comme le mode Livres.

À l’avenir, le défi consistera à équilibrer innovation et responsabilité. Les régulateurs, les chercheurs et les entreprises technologiques se concentrent de plus en plus sur la définition de normes de sécurité pour les interactions de l’IA, en particulier dans des contextes émotionnellement sensibles.

Alors que l’IA continue d’évoluer d’un outil à une présence semblable à un compagnon, des fonctionnalités telles que les livres peuvent représenter l’avenir du divertissement – mais aussi un test pour savoir avec quelle sécurité cet avenir peut être construit.