OpenAI a lancé trois nouveaux modèles audio dans son API Realtime, et ils représentent un gros problème pour quiconque crée des applications vocales. Les trois modèles sont GPT-Realtime-2, GPT-Realtime-Translate et GPT-Realtime-Whisper.

Ensemble, ils font évoluer l’IA vocale au-delà des simples échanges de réponses vers quelque chose qui peut vous comprendre, agir et suivre une vraie conversation.

Si l’on en croit leur démo, nous venons de voir la prochaine évolution dans le fonctionnement des modèles d’IA vocale.

Alors, que peuvent réellement faire ces modèles ?

GPT-Realtime-2 est le titre phare. Il apporte un raisonnement de classe GPT-5 aux interactions vocales en direct, ce qui signifie qu'il peut traiter des demandes plus difficiles sans interrompre le fil de la conversation.

Il peut appeler plusieurs outils simultanément et même raconter ce qu'il fait avec des expressions telles que « vérifier votre calendrier » ou « laissez-moi examiner cela ». Il dispose également d'une fenêtre contextuelle plus grande de 128 000 jetons, ce qui signifie des sessions plus longues et plus cohérentes. Les développeurs peuvent même ajuster l’effort de raisonnement en fonction de la complexité de la demande.

GPT-Realtime-Translate est probablement mon préféré. C'est ce qui se rapproche le plus du traducteur universel de Star Trek dans la vraie vie. Il prend en charge la traduction vocale en direct dans plus de 70 langues d'entrée et 13 langues de sortie.

La meilleure partie de la démo était que même lorsqu'une nouvelle personne rejoignait et parlait une langue différente, GPT-Realtime-Translate n'avait aucun problème à traduire les deux locuteurs vers l'anglais en temps réel.

Enfin, il y a le GPT-Realtime-Whisper. La plupart des modèles de synthèse vocale attendent que l'orateur ait terminé avant de fournir la traduction complète. Celui-ci est un modèle de transcription en streaming qui convertit la parole en texte pendant que l'orateur parle. Il est utile pour les sous-titres en direct, les notes de réunion et tout flux de travail vocal où l'attente d'une transcription n'est pas une option.

Tout le monde peut-il utiliser ces nouveaux modèles d’IA vocale ?

Actuellement, OpenAI a publié ces modèles pour les développeurs. Mais les applications qu’ils créent affecteront tout le monde. Par exemple, un développeur peut créer une application de traduction en temps réel, permettant aux utilisateurs de converser avec des personnes dans différentes langues.

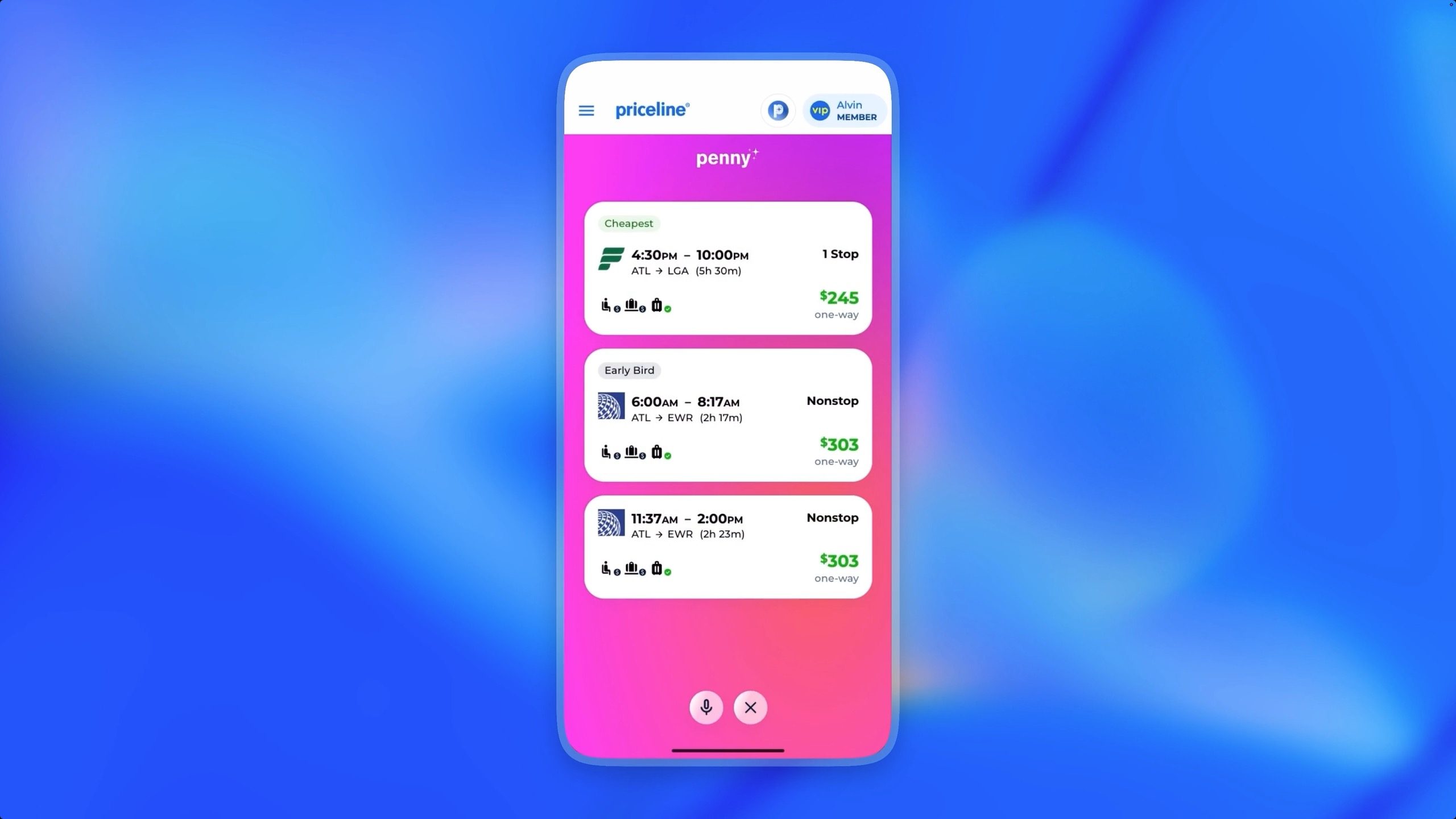

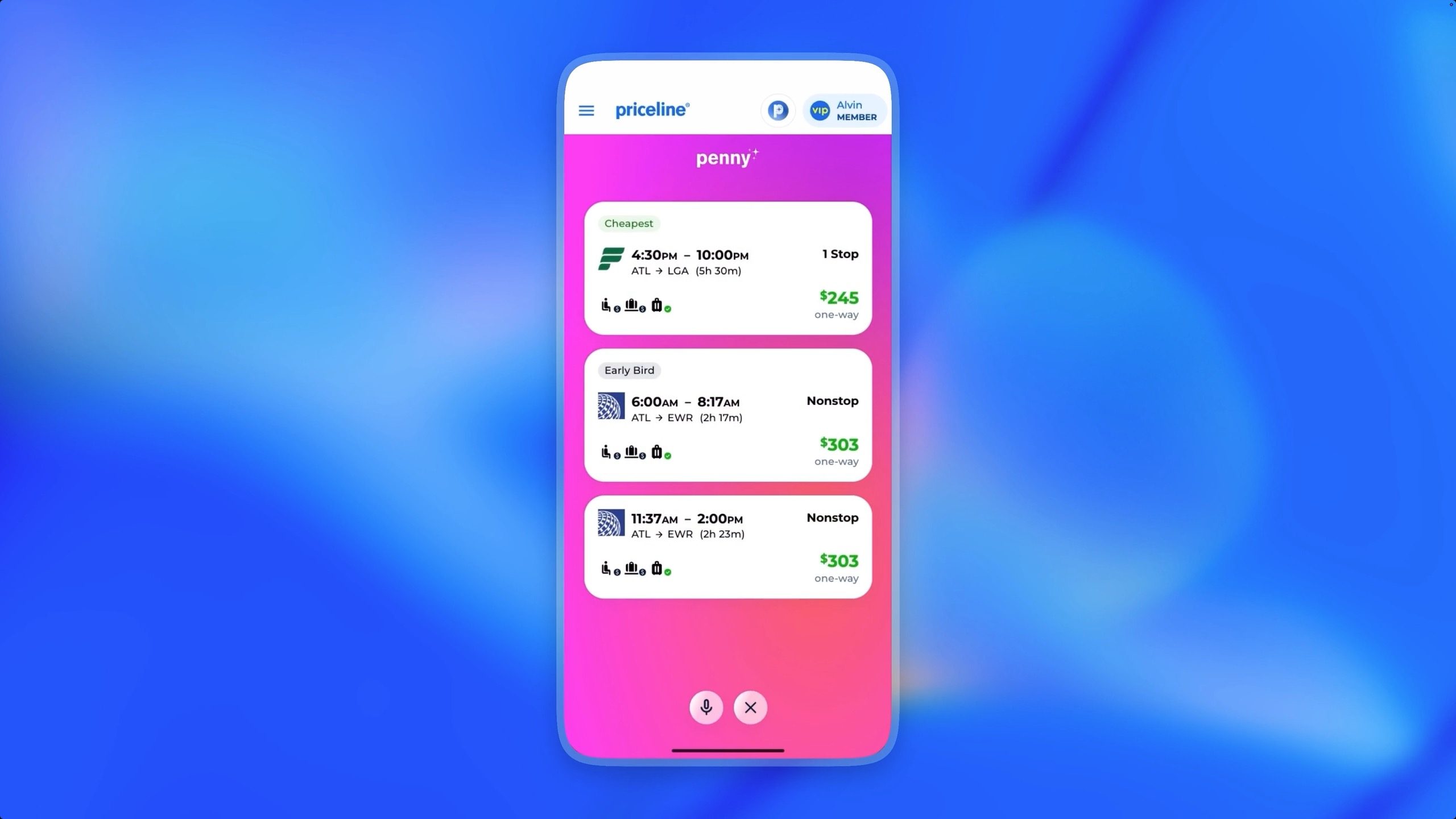

De nombreuses entreprises testent déjà ces nouveaux modèles. Zillow construit un assistant vocal capable de rechercher des maisons et de planifier des visites à partir d'une seule demande vocale. Priceline peut vérifier vos vols et hôtels, les annuler et en réserver de nouveaux. Vimeo l'utilise pour la transcription en temps réel, etc.

Le prix commence à 0,017 € par minute pour Whisper, 0,034 € par minute pour Translate et 32 € par million de jetons d'entrée audio pour GPT-Realtime-2.