Jusqu'à présent, le Japon a été assez silencieux pendant le boom de l'IA, mais maintenant – juste après toute la tendance de Chatgptxghibli – la société japonaise Animon a sorti un générateur de vidéos IA spécifiquement pour l'anime.

L'outil gratuit prend des images fixes d'anime, de dessin animé ou d'art CG et crée des animations de cinq secondes basées sur l'invite que vous entrez. La société affirme qu'elle aidera les animateurs professionnels et amateurs à accélérer le processus créatif – ne nécessitant essentiellement qu'un cadre dessiné à la main pour cinq secondes de vidéo au lieu de centaines.

Y a-t-il une place pour les outils d'IA dans l'industrie animée?

Confession rapide ici – il se trouve que je suis un nerd anime total. J'ai regardé des centaines de spectacles, je visite le Japon presque chaque année, j'y ai travaillé et je parle japonais. Je ne suis pas un expert du processus d'animation, mais je sais à quoi ressemble une bonne animation et à quoi ressemble la mauvaise animation.

Même sans l'implication de l'IA, il existe déjà beaucoup de façons de couper les coins avec l'animation dans l'industrie de l'anime. Une grande partie du travail est désormais externalisée dans les studios d'animation coréens, et le temps et l'argent qui y vont continuer à baisser.

Lorsqu'un studio n'investit pas suffisamment dans son animation, il affecte les émissions de deux manières principales: il y a beaucoup moins de mouvement, et il y a une baisse notable de la qualité de l'art. Les conceptions des personnages peuvent être belles sur les affiches promotionnelles, mais les versions tirées d'un cadre à l'autre n'ont pas le même niveau de détail ou les bonnes proportions, et dans certains cas, ils semblent même Derpy.

J'en ai un exemple malheureux d'un spectacle que j'aime (un anime de volleyball populaire appelé Haïkyuu). Les épisodes antérieurs ont été très bien animés, mais pour une raison quelconque, la qualité a chuté au cours de l'une des dernières saisons. Voici une image comparant une photo du protagoniste d'un épisode de la saison un à un épisode de la saison quatre.

Pour être clair, certains spectacles ont toujours fière allure – mais l'animation de basse qualité peut apparaître à peu près n'importe où, et cela peut certainement être assez mauvais pour chasser les téléspectateurs comme moi.

Avec le bar qui coule si bas, vous pourriez penser que les outils de génération de vidéos IA ont en fait une chance dans cette industrie. Cependant, à en juger par le contenu que j'ai obtenu d'Animon.ai, j'ai peur que cela ne semble pas être le cas.

À quoi ressemblent les animations générées?

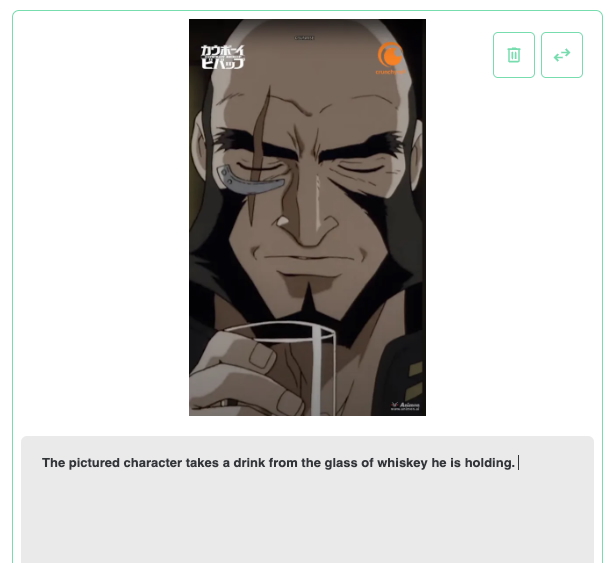

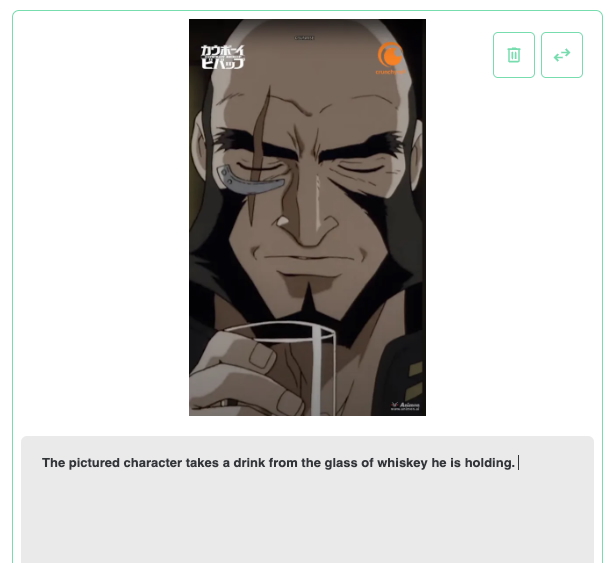

L'outil fonctionne en ce qu'il prend l'image que vous lui donnez et le fait bouger pendant cinq secondes, mais c'est à peu près tout ce que vous pouvez garantir. Pour ma première expérience, je lui ai donné un noir de noir de Cowboy Bebop Sur le point de boire dans un verre de whisky.

Mon invite était simplement «le personnage illustré prend un verre du verre de whisky qu'il tient.» La vidéo que j'ai obtenue en retour a quelques choses qui se trompent.

Premièrement, Jet Black ne boit pas le whisky. Il semble parler, et il soulève le verre plus près de son visage, mais je ne vois rien qui ressemble à de la consommation d'alcool réelle. Le whisky à l'intérieur du verre semble cependant très occupé – le verre se remplit et se draine malgré le manque de consommation d'alcool qui semble se dérouler. Si vous voulez voir la boisson Jet pour de vrai, c'est ici sur YouTube.

Le modèle d'IA a également du mal avec la cicatrice de Jet. L'extrémité inférieure disparaît en quelque sorte, et quand il ouvre les yeux, la cicatrice va directement sur son globe oculaire. Parce que j'ai attrapé l'amélioration d'une vidéo sur la chaîne YouTube de Crunchyroll, il a le logo de CR en haut à droite. Dans la vidéo AI, cependant, le texte semble se transformer en «Crunchyolo» à la place.

Ensuite, j'ai essayé de le nourrir de la scène de danse de Maomao de Les journaux d'apothicaireet j'ai obtenu un résultat vraiment bizarre. Contrairement aux mouvements trippants, pâteux et morphings de la vidéo à jet 2D, l'IA m'a donné ce qui ressemblait à un modèle 3D.

Animon.ai est également censé travailler avec CG Art, donc je suppose qu'il est logique qu'il puisse générer des modèles 3D, mais j'ai été assez surpris. Alors que Les journaux d'apothicaire Utilise beaucoup de modèles 3D pour les bâtiments et les arrière-plans, le personnage était définitivement dessiné dans la photo que j'ai utilisée.

Quoi qu'il en soit, les vidéos générées semblent beaucoup plus stables lorsque des modèles 3D sont impliqués. Le mouvement semble moins sloshy et le modèle maintient la taille et la forme du caractère plus cohérentes. Je ne voudrais toujours pas le voir dans un spectacle tel quel, mais c'est sans aucun doute une étape du contenu de style 2D qu'il m'a donné.

Cependant, le terrain de vente d'Animon.ai consiste à aider les animateurs à gagner du temps en dessinant moins de trames – et ce n'est pas pertinent en ce qui concerne l'animation 3D. Il est déjà rapide et peu coûteux par rapport à 2D, et il n'est pas très logique de créer un modèle 3D, puis d'utiliser un générateur de vidéos AI pour l'animer au hasard plutôt que d'utiliser un logiciel d'animation.

Devriez-vous utiliser animon.ai?

Si vous ne savez rien de l'animation et que vous voulez un gif rapide ou une vidéo à des fins personnelles, cet outil fonctionnera probablement très bien (ou vous donnera un bon rire sinon). Cependant, il est difficile d'imaginer un amateur ou des animateurs professionnels qui y voient une réelle valeur.

Si vous voulez voir de quoi l'outil est capable, la chaîne YouTube Animon a publié un clip vidéo qui semble être presque 100% généré par AI – il semble certainement ainsi.

Dans l'ensemble, je pense qu'il y a deux principales raisons pour lesquelles les générateurs de vidéos IA ne sont pas prêts pour un vrai travail. L'un est que le mouvement semble trop mauvais, et l'autre est le manque de contrôle que vous avez sur le résultat. C'est la même chose que tout autre outil d'IA génératif, vraiment – ils ne sont tout simplement pas assez cohérents et réactifs pour être fiables. Nous y arriverons probablement un jour, et c'est toujours amusant de jouer avec les premières versions de la technologie, mais ne laissez pas les vendeurs vous tromper – aucun de ces outils n'est encore prêt à l'usage commercial.