Les chatbots IA ont rendu étonnamment facile la discussion sur n'importe quoi, y compris certains des sujets les plus lourds imaginables. Cette ouverture a toujours été une arme à double tranchant. OpenAI prend désormais une mesure pour résoudre ce problème, avec une nouvelle fonctionnalité qui fait intervenir une personne de confiance lorsque les choses deviennent sérieuses.

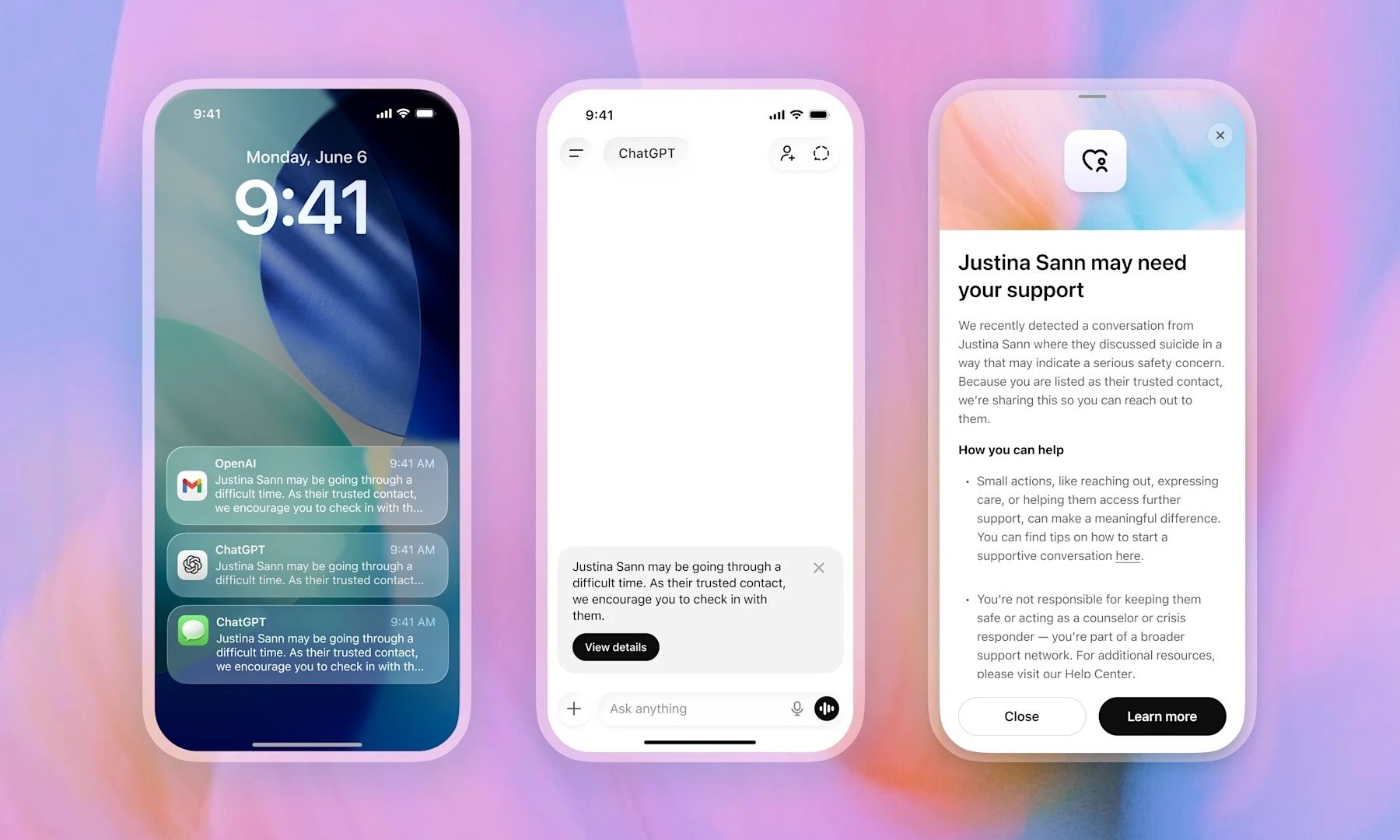

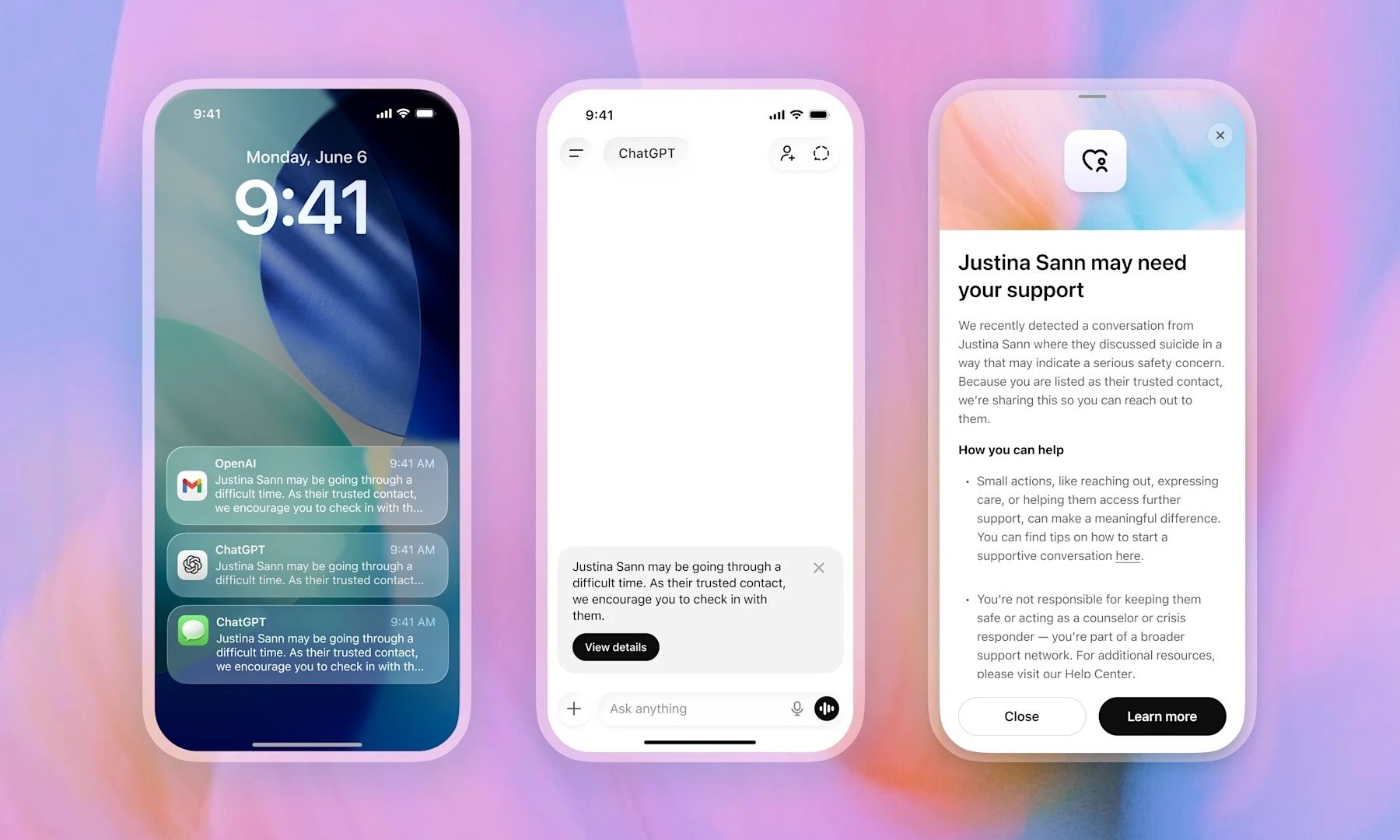

La société déploie une nouvelle fonctionnalité appelée Trusted Contact, et elle commence à apparaître dans les paramètres ChatGPT pour les utilisateurs adultes. Il permet aux utilisateurs de nommer une personne qui peut être alertée si ChatGPT détecte un grave problème d'automutilation.

Comment fonctionne le contact de confiance ?

La configuration d'un contact de confiance est facultative, mais si vous décidez de le créer, vous devez vous assurer que le contact que vous nommez est âgé d'au moins 18 ans, ou 19 ans en Corée du Sud. Une fois que vous avez nommé quelqu'un, il reçoit une invitation expliquant ce que signifie réellement le rôle, et il a une semaine pour l'accepter avant la mise en ligne de la fonctionnalité. S'ils refusent, vous pouvez choisir quelqu'un d'autre.

Le système d'alerte lui-même n'est pas automatique. Si les systèmes de ChatGPT signalent une conversation comme potentiellement préoccupante, le chatbot indique d'abord à l'utilisateur que son contact de confiance peut être averti, et il incite également l'utilisateur à contacter directement certains démarreurs de conversation suggérés. Une petite équipe d’examinateurs humains spécialement formés intervient alors pour évaluer la situation. Ce n'est que s'ils confirment un risque sérieux que le contact est réellement averti, par e-mail, SMS ou notification dans l'application. L'alerte ne partage pas les transcriptions du chat ni les détails de la conversation. Il indique simplement que l'automutilation est apparue d'une manière potentiellement inquiétante et demande au contact de s'enregistrer. OpenAI dit qu'il vise à terminer cet examen humain en moins d'une heure.

Pourquoi OpenAI ajoute-t-il cela maintenant ?

Le contact de confiance fait partie d'un ensemble plus large de fonctionnalités de sécurité sur la plateforme. Auparavant, OpenAI ajoutait des fonctionnalités permettant aux parents de recevoir des alertes lorsqu'un compte adolescent lié montre des signes de détresse. Trusted Contact est l’extension destinée aux adultes de cette même fonctionnalité. Il aurait été développé avec la contribution de cliniciens, de chercheurs et d’organisations de santé mentale, notamment l’American Psychological Association.

Cela dit, il convient de mentionner que Trusted Contact ne remplace pas les lignes d'assistance téléphonique en cas de crise, les services d'urgence ou les soins professionnels de santé mentale. ChatGPT dirigera toujours les utilisateurs vers ces ressources en cas de besoin. Les utilisateurs peuvent supprimer ou modifier leur contact de confiance à tout moment, et les contacts peuvent se supprimer eux-mêmes quand ils le souhaitent.

La réalité est que ChatGPT est utilisé pour des conversations profondément personnelles, que OpenAI l'ait prévu ou non. L’ajout d’une fonctionnalité telle que Trusted Contact est un pas dans la bonne direction, mais aussi l’aveu qu’un chatbot ne peut pas faire grand-chose.