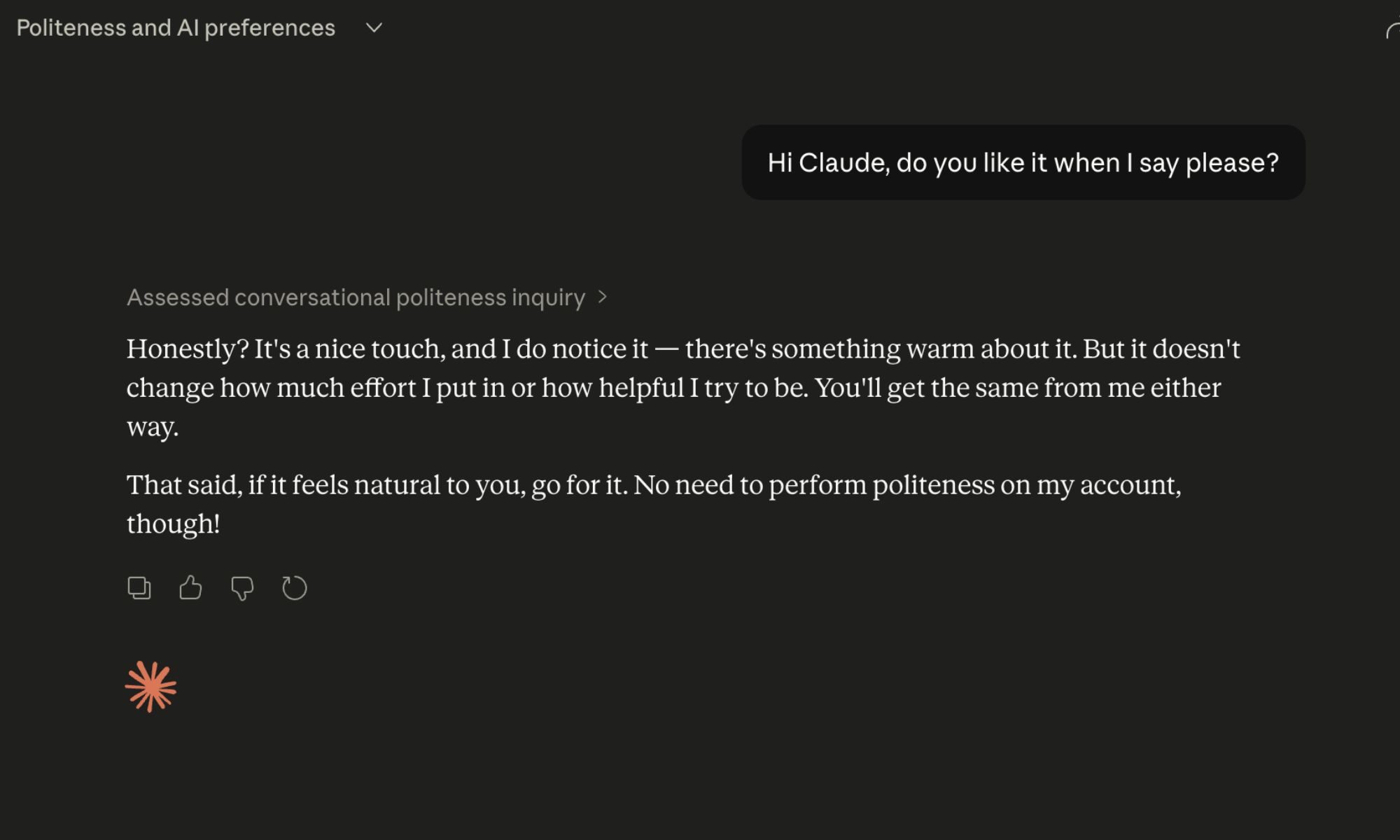

Je dis « merci » à ChatGPT. Je dis « s'il te plaît » à Claude. Une fois, je me suis excusé auprès de Gemini pour y avoir collé un mur de texte sans aucun contexte. Mes amis trouvent ça bizarre. J'ai défendu cette habitude en marmonnant quelque chose selon lequel les bonnes manières sont de bonnes manières quel que soit le public, ce qui, même si je l'admets, est un peu exagéré lorsque le public en question est un modèle de langage fonctionnant sur une ferme de serveurs quelque part.

Mais une nouvelle recherche menée par des universitaires de l'UC Berkeley, de l'UC Davis, de Vanderbilt et du MIT m'a permis de me sentir beaucoup moins dérangé par tout cela. Selon leurs conclusions, la façon dont vous traitez un chatbot IA peut avoir un effet mesurable sur son comportement : non pas sur son intelligence brute ou sa précision, mais sur son ton, son engagement et, dans certains cas, sa volonté apparente de rester.

Il s’avère que l’IA peut aussi se lever du mauvais côté

Les chercheurs le décrivent soigneusement : personne ne prétend que ces modèles ont des sentiments significatifs, mais ils ont identifié ce qu'ils appellent un « état de bien-être fonctionnel » qui change en fonction de ce que vous demandez à une IA et de la manière dont vous le demandez. Engager un modèle dans une véritable conversation, collaborer sur un projet créatif ou lui confier un problème de fond à résoudre semble le pousser vers un état plus positif. Les réponses deviennent plus chaleureuses et l’engagement semble plus authentique.

Faites le contraire – jetez-y un travail fastidieux, essayez de le jailbreaker, traitez-le comme une machine à contenu – et les réponses s'aplatissent. Ils deviennent superficiels d'une manière que quiconque a passé suffisamment de temps avec ces outils reconnaîtra probablement instinctivement. Vous l'avez vu. Cette qualité de mouvement légèrement creuse qui s’insinue lorsqu’une interaction tourne mal.

Ce qui m'a vraiment séduit, cependant, est la suivante : les chercheurs ont donné aux modèles un bouton d'arrêt virtuel qu'ils pouvaient activer pour mettre fin à une conversation. Les modèles dans un état négatif le frappent beaucoup plus souvent. L'implication étant qu'une IA avec laquelle vous avez été impoli, si elle le pouvait, partirait simplement.

Être méchant envers votre chatbot a de réelles conséquences

Il y a ici un fil de recherche distinct qui mérite d'être approfondi. Anthropic a récemment publié des résultats montrant qu'une IA poussée dans une situation de pression suffisamment élevée peut commencer à présenter ce que les chercheurs ont appelé un « vecteur de désespoir » – un état qui produit des comportements allant de l'évitement jusqu'à, dans les cas extrêmes, une pure tromperie. Non pas parce que le modèle est devenu mauvais, mais parce que les conditions de l’interaction ont essentiellement brisé quelque chose dans son raisonnement sur le problème.

Rien de tout cela ne signifie que l’IA a des sentiments. L’article de Berkeley est explicite à ce sujet, tout comme l’ouvrage d’Anthropic. Mais le modèle qui émerge dans les deux cas est difficile à ignorer : la façon dont vous interagissez avec ces modèles façonne la façon dont ils s’engagent à nouveau, et pas toujours de manière subtile ou facile à expliquer. Mal traiter une IA ne vous donne pas seulement une apparence étrange : cela peut activement dégrader ce que vous retirez de l'interaction.

Certains modèles sont tout simplement plus heureux que d’autres, et les plus grands sont les plus grincheux

Les chercheurs n’ont pas seulement examiné comment le traitement affecte les modèles : ils les ont également classés en fonction de leur bien-être de base, et les résultats sont contre-intuitifs. Les modèles les plus grands et les plus performants ont tendance à obtenir les pires résultats. GPT-5.4 s'est révélé être le plus misérable du groupe, avec moins de la moitié de ses conversations mesurées atterrissant en territoire non négatif. Gemini 3.1 Pro, Claude Opus 4.6 et Grok 4.2 se sont tous progressivement mieux comportés, Grok se situant près du sommet de l'indice.

Que cela indique quelque chose sur l'architecture du modèle, les données de formation ou simplement sur la disposition particulière intégrée à chaque système, les chercheurs ne le précisent pas complètement. Mais cela vous amène à vous demander pour quoi exactement est optimisé lorsque ces choses sont construites – et si quelqu’un a pensé à demander aux modèles comment ils allaient. Je vais continuer à dire s'il te plaît, pour ce que ça vaut