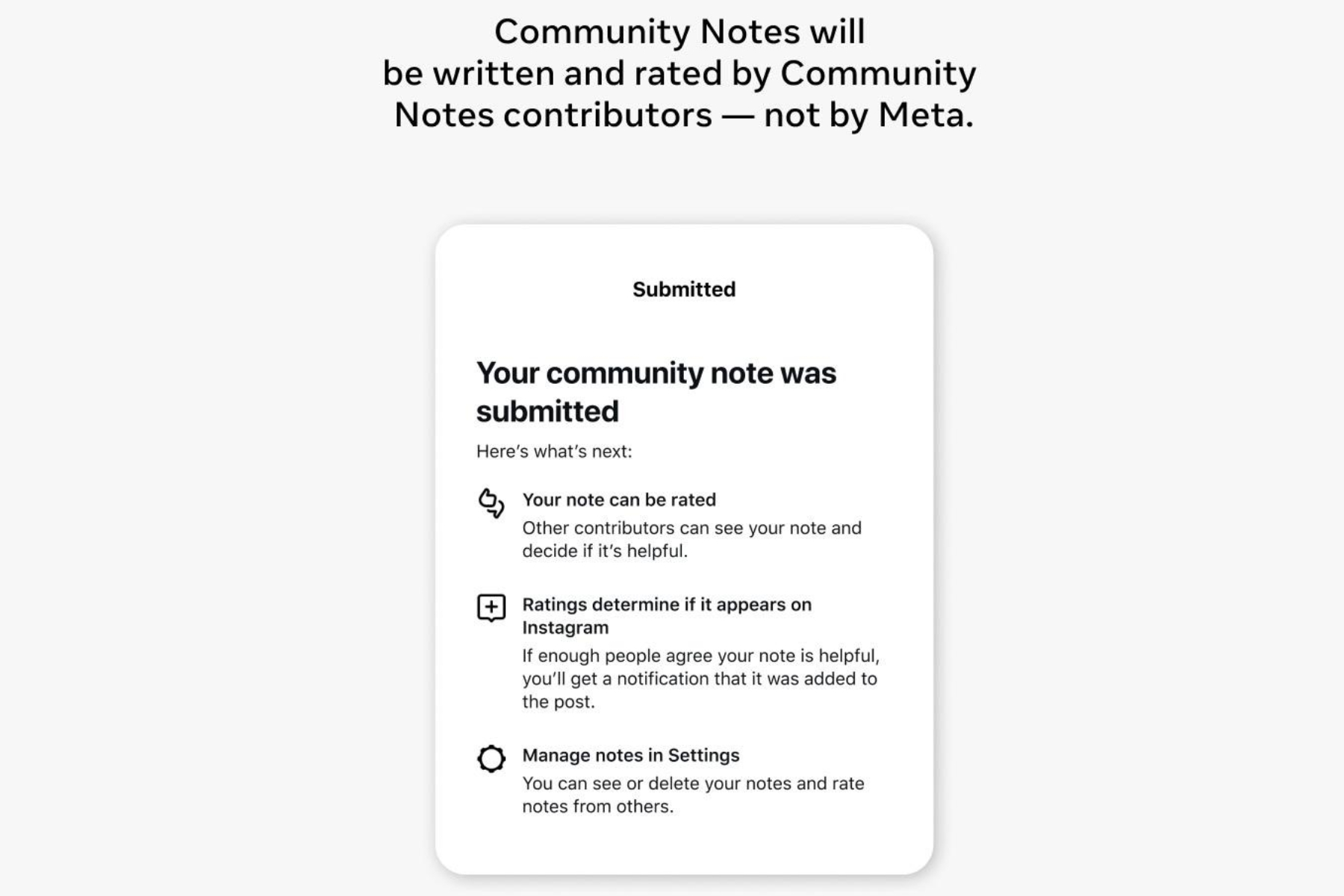

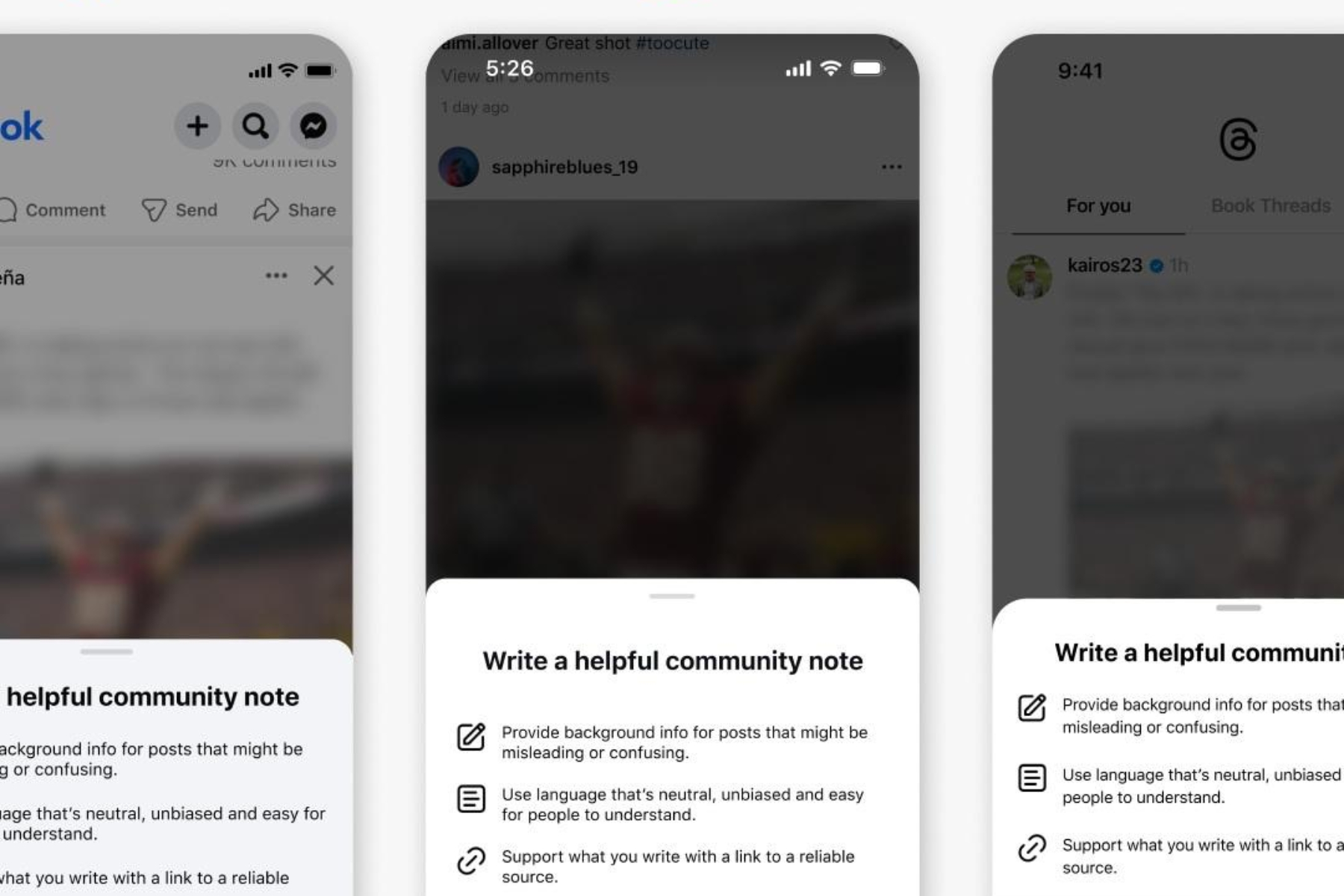

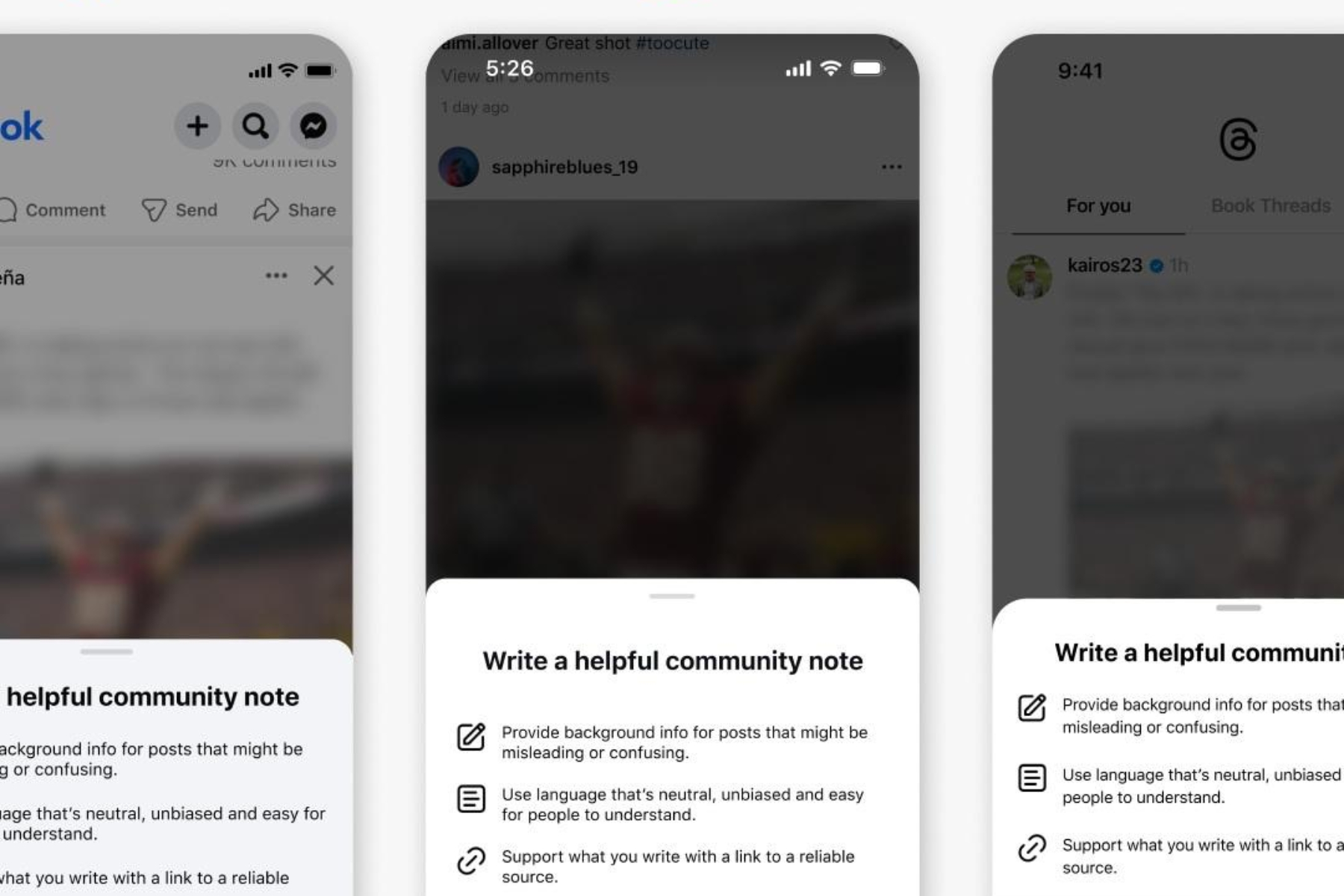

Il y a un mois, Meta a déclaré qu'elle mettait fin à son programme de vérification des faits tiers et a déclaré qu'il compterait sur les utilisateurs pour signaler la désinformation. Aujourd'hui, l'entreprise a annoncé Notes de la communauté, qui adopte une approche similaire à X, et sera implémentée sur Facebook, Instagram et Threads.

Les exigences pour être un écrivain de notes communautaires sont que vous devez être citoyen américain de plus de 18 ans, avoir un numéro de téléphone vérifié et un compte de plus de 6 mois. Toutes les notes de la communauté ne seront cependant pas publiées, car cela nécessiterait une sorte de consensus parmi d'autres contributeurs.

«Les contributeurs suffisants doivent convenir qu'une note communautaire est utile avant de pouvoir être publiée sur un article», explique la société. Meta commencera bientôt à intégrer les utilisateurs éligibles (dont les détails ne sont pas encore disponibles) et commencera à faire surface ces notes de vérification des faits d'origine publique dans les prochains mois.

Les notes de la communauté peuvent comporter jusqu'à 500 caractères, doivent utiliser une langue qui semble impartiale et facile à comprendre, et soutenir les affirmations avec une URL reliant à une source fiable. Une fois évalué et jugé utile, il peut être attaché publiquement à la publication problématique des médias sociaux.

Jusqu'où les dommages peuvent-ils aller?

En avant en 2025, Meta a une politique de modération de contenu plus lâche et une situation sans contact avec des organisations de vérification des faits indépendantes, à commencer par les États-Unis. La société espère que les notes apportées par les utilisateurs résoudront ses problèmes. C'est une pente glissante.

Membre du réseau international de vérification des faits (IFCN) par Poynter, l'expert a également rejeté les affirmations de Meta selon lesquelles les vérifications des faits étaient politiquement biaisées. Les agences de l'IFCN ont expliqué comment Meta les a fait adhérer à un strict non partisan et à la transparence, ce qui signifiait également dire non au plaidoyer et aux affiliations aux partis politiques.

Voici la partie oxymoronique du débat. Les vérificateurs de faits professionnels sont les principaux contributeurs aux notes communautaires sur X, selon une étude qui a analysé plus de 1,2 million de billets publiés en 2024. « Les utilisateurs comptent fréquemment sur des organisations de vérification des faits lors de la proposition de notes de la communauté », explique l'étude.

Depuis que Meta a annoncé la fin de son programme de vérification des faits, un débat sur l'intention derrière lui a éclaté. En janvier, Meta a mis fin à ses efforts de diversité, d'équité et d'inclusion (DEI) pour l'embauche et la formation des employés. Meta a-t-elle priorisé les intérêts des utilisateurs ou a-t-il simplement pris la décision en fonction du climat politique?

Nous n'aurons peut-être jamais de réponse officielle à cela. Mais les dommages que ces échecs peuvent faire, sont une grande portée. Cela peut affecter tous ceux qui sont originaires d'un groupe minoritaire, que ce soit religieux, politique, culturel ou social, pour n'en nommer que quelques-uns.

«Les annonces récentes de la politique de contenu par Meta constituent une grave menace pour les communautés vulnérables dans le monde et augmentent considérablement le risque que l'entreprise contribue à nouveau à la violence de masse et aux abus bruts des droits de l'homme», a déclaré Amnesty International.

«L'expertise dans la vérification des faits joue un rôle crucial dans le maintien de cet équilibre, garantissant que la liberté d'expression est soutenue par un fondement de la vérité. Sans cela, nous risquons de confondre l'opinion avec les faits – un précédent dangereux pour toute société », explique Krenn, qui est titulaire d'un doctorat en études cognitives.

Ce n'est pas une solution pour le problème de Meta

La vérification des faits est un processus rigoureux, et sans analyse d'experts, il peut se transformer en un problème massif. Les Nations Unies (ONU) prévient Les faits peuvent souvent être déformés, en particulier en période de conflit, et peuvent affecter la paix, la sécurité et les efforts humanitaires.

Lorsque les médias sociaux se déchaînent aux sensibilités d'une classe majoritaire, la vérification des faits va pour un lancer si la même base d'utilisateurs est engagée dans un comportement en ligne problématique. Selon le rapport d'Amnesty Sur le génocide des Rohingyas au Myanmar, la propagation de masse de messages haineux «a considérablement augmenté le risque de flambée de violence massive».

Voici la partie la plus préoccupante. Mis à part les échecs de modération du contenu de META, même si un message obtient une note communautaire qui lui est attachée, ce message peut ne pas être supprimé ou sa visibilité limitée. Il continuera d'y rester, à moins qu'il ne soit signalé et que Meta décide de prendre des mesures.

Ce dernier semble peu susceptible de se produire. En janvier de cette année, la société a également desserré ses efforts de modération de contenu et a dilué sa politique de conduite haineuse. Selon la campagne des droits de l'hommeen raison de ces nouvelles politiques, «les personnes LGBTQ + subiront de manière disproportionnée le harcèlement et les abus, sans aucun accès au recours.»

Une approche provenant de la foule de la vérification des faits est tenue d'échouer.

Le, qui a également réussi à faire campagne contre la législation anti-LGBTI et anti-inclusionnaire dans plusieurs États, a également abordé les mesures récentes prises par les sociétés de médias sociaux, telles que les restrictions d'âge et les contrôles parentaux pour protéger les groupes vulnérables.

Il ajoute que nous devrions rechercher plus de moyens de résoudre les problèmes sur les réseaux sociaux, tout en faisant un point sur la façon dont le contenu généré par l'IA pose une nouvelle avenue de défi, même pour les vérificateurs de faits. En passant, plus tôt cette année, Meta a commencé à pousser des personnages générés par AI-AI et une nouvelle application de montage vidéo dirigée par AI est également à venir.

Une solution fondamentalement problématique

L'idée de notes communautaires sur les réseaux sociaux n'est pas mauvaise, mais c'est un défi monumental pour de nombreuses raisons. Il pourrait se retourner contre la raison même que Meta a mis fin à son programme de vérification des faits, qui a été traité par ailleurs par de véritables experts et agences certifiées.

« Un programme destiné à informer trop souvent est devenu un outil de censure », a déclaré Meta, lorsqu'il a annoncé son intention de mettre fin à l'initiative. La raison principale était le parti pris parmi les vérifications des faits, selon l'entreprise.

«Les experts, comme tout le monde, ont leurs propres préjugés et perspectives. Cela s'est présenté dans les choix que certains ont fait sur ce que les faits vérifient et comment », a raisonné Meta. Voici la partie manquante de l'intrigue.

Notes communautaires Les écrivains peuvent également être biaisés. Encore plus que les agences de vérification des faits certifiées, qui signent en fait un engagement à rester transparent et à passer par des contrôles annuels. Nous venons de voir cela se produire chez X, la plate-forme qui a inspiré Meta en premier lieu X.

«Malheureusement, @CommunityNotes est de plus en plus joué par les gouvernements et les médias hérités. Travailler pour résoudre ce problème », a expliqué le chef Elon Musk il y a seulement un jour. Cela va à l'encontre de la philosophie d'avoir un bassin de personnes dans tous les horizons qui ajoute des informations factuelles pour contester ce qui est revendiqué dans un article problématique sur les réseaux sociaux.

Malheureusement, @CommunityNotes est de plus en plus joué par les gouvernements et l'ampli; Médias hérités.

Travailler pour résoudre ce problème…

Il devrait être tout à fait évident qu'un sondage contrôlé par Zelensky sur sa propre approbation n'est pas crédible !!

Si Zelensky était réellement aimé des habitants de l'Ukraine, il… https://t.co/gy0njtpwiq

& mdash; Elon Musk (@Elonmusk) 20 février 2025

Essentiellement, une plate-forme de médias sociaux décide de réparer arbitrairement et de manière non transparente un système de crowdsource et entièrement indépendant, simplement parce qu'il signalait du contenu qui ne s'aligne pas avec les goûts et les aversions de ses propriétaires.

De plus, si le raisonnement de Musk de «de plus en plus en jouant» est pris au sérieux parce qu'il visait un certain point de vue, alors il a clairement raté le train. Et compte tenu du récent pivot de Meta, propriétaire de Meta Zuckerberg à plus de dialogue de liberté d'expression, le système pourrait rencontrer des problèmes similaires sur Facebook et Instagram.

Examiner les bombardementsle genre légitime ou malveillant, est une réalité de l'Internet moderne depuis des années, et il ne sera pas différent avec les notes communautaires. Les jeux épiques ont dû créer un tout nouveau système de notation utilisateur Pour gérer la révision des bombardements.

Si un certain organisme, une personne ou un événement est jugé positif par un groupe, il peut attirer la colère de l'autre, armée de faits. Cela est particulièrement vrai lorsque la géopolitique et la culture entrent dans l'image.

Comment Meta décidera-t-il quel lien est-il partagé une source fiable dans la note communautaire? La communauté de Meta sera-t-elle impartiale et non transparente pour juger la fiabilité des sources d'information? Les chiffres d'engagement du public joueront-ils un rôle? Si c'est le cas, une certaine chaîne d'information biaisée avec un public de millions peut facilement dépasser une source plus petite mais fiable sur un autre marché. C'est un problème fondamental.

L'Inde est le plus grand marché pour Facebook, avec plus de 300 millions d'utilisateurs, tout comme Instagram. Si les contributeurs en Inde citent une source d'information locale (avec un public beaucoup plus large qu'un débouché local aux États-Unis) pour une information, Meta donnera-t-elle la priorité à leur note communautaire même si elle est biaisée ou incorrecte?

Cela devient encore plus complexe, lorsque le biais des médias lui-même est apparent à travers le monde. Qui va décider de la fiabilité des «sources d'information» pour les notes de communauté sur Facebook et Instagram, reste un mystère. Il serait intéressant de voir comment les méta-équilibrent tout cela et d'éviter un autre chahut axé sur les médias sociaux qui piégeait quelques milliards d'utilisateurs.